3.3. Aproximaciones conceptuales

3.3.6. Sesgos

El último bloque crítico de contenidos orbita alrededor de los sesgos y, por lo tanto, pone el foco en las desigualdades causadas o agravadas por las tecnologías y sus interfaces. Esto tiene implicaciones reales y graves, como la detención errónea de un hombre negro que había sido reconocido por una inteligencia artificial como la persona que había robado cinco relojes. Lo que es más interesante es que la tecnología en general y los algoritmos, o las interfaces en particular, reflejan los sesgos de las personas que los han construido. Como creadores, tenemos que poner especial atención a nuestros propios sesgos, puesto que tienen consecuencias directas sobre otras personas. Consultad la ficha El sesgo del diseñador en el Design Toolkit de la UOC.

Artísticamente, podemos hablar de Estampa, un colectivo que aborda las rendijas de los diferentes algoritmos de reconocimiento facial, corporal u otros tipos. Sus trabajos suelen tener un carácter de investigación que se concreta en múltiples formatos (vídeo, acciones o instalaciones…) y ponen, por ejemplo, el foco en la ambigüedad de los diferentes tags o etiquetas que establecen los algoritmos o en el procesamiento de imágenes mediante redes neuronales.

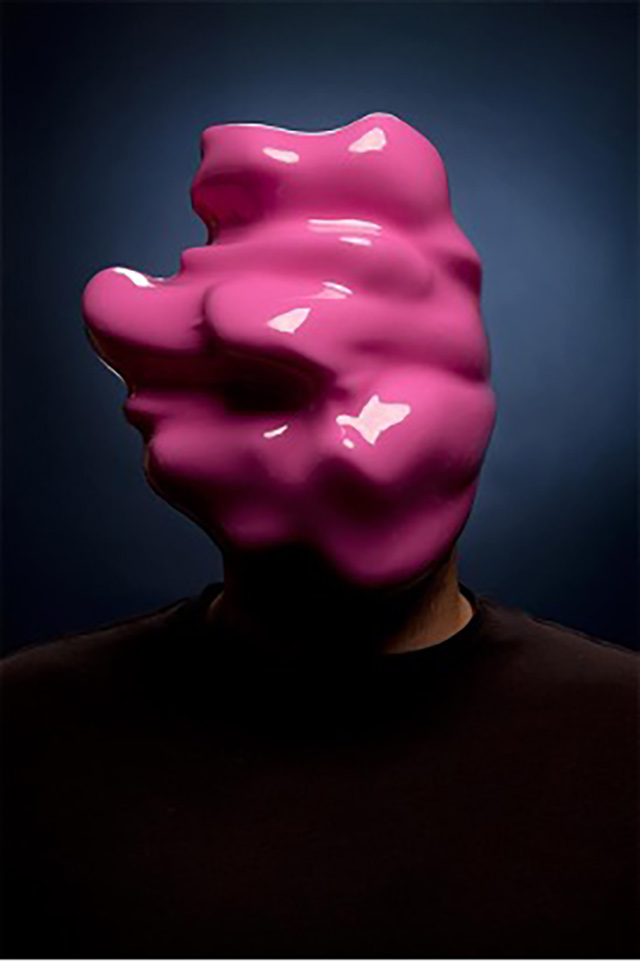

De manera más específica, podemos hablar del artista Zach Blas y Facial Weaponization Suite, un proyecto que protesta contra el reconocimiento facial biométrico y las desigualdades que estas tecnologías propagan. Lo hace con talleres que consisten en crear máscaras de forma colectiva, máscaras que reúnen los datos faciales de las distintas personas que participan y que acaban teniendo un aspecto amorfo que no puede ser detectado como rostro humano por las tecnologías de reconocimiento facial.

Figura 23. Facial Weaponization Suite (2012 – 2014) de Zach Blas

Fuente: web del artista.

Más concretamente, también hay que mencionar Fairly Intelligent, un proyecto de A. M. Darke. La artista ha creado un algoritmo especulativo que confronta los sesgos racistas, clasistas y de otros tipos mediante un juego en formato web a lo largo del cual el usuario responde a varias preguntas.

Siguiendo las propuestas en formato web, Suspicious behavior, del colectivo Kairus (Linda Kronman y Andreas Zingerle) invita al usuario a reflexionar sobre los prejuicios humanos que acaban siendo traspasados a las máquinas y que influyen, por lo tanto, en los diferentes algoritmos de reconocimiento. Mediante un vídeotutorial, someten el usuario a diferentes pruebas de reconocimiento de imágenes captadas por cámaras de videovigilancia.

Este proyecto está directamente ligado al concepto de trabajo fantasma (o ghost work), un término que hace referencia a las microtareas que llevan a cabo millones de personas para alimentar, clasificar, corregir o evaluar datos. Estas tareas sirven para optimizar, por ejemplo, que Alexa falle menos a la hora de reconocer voces o que las redes sociales detecten cuerpos desnudos. La parte negativa es que estos trabajos se basan en la precariedad laboral y son invisibilizados, hecho que impide poder reclamar condiciones de trabajo más justas o, incluso, contar cuántas personas están dedicando el tiempo a estas tareas.